兄弟们,今天学姐不聊手机电脑,咱们来聊聊一个更炸裂的话题——AI诈骗!最近央视曝光的新型诈骗手法简直让人头皮发麻,福建某老板10分钟就被骗走430万,这波骗子属实是把AI技术玩出花了!作为数码圈老司机,学姐必须带大家扒一扒这些”高科技”骗局的内幕,顺便教几招防身术。

根据新京报有理数的调查数据,AI诈骗案件已经从2020年的0.2万元涉案金额,暴增到2023年的1670万元,年复合增长率高达1928.8%。

2024年刚过半,案件金额就突破1.85亿,这增长速度比特斯拉股价还猛!

更可怕的是,现在的AI诈骗已经形成了一条完整的黑色产业链:

– 上游:技术大佬在暗网卖”AI换脸套餐”,价格从几百到几万不等

– 中游:信息贩子用非法获取的个人数据精准投放诈骗信息

– 下游:洗钱团伙通过虚拟货币、跑分平台转移资金

这产业链完整度,比特斯拉的超级工厂还专业!

二、谁在成为AI诈骗的”精准目标”?

传统电诈喜欢盯着”一老一少”,但AI诈骗的受害者画像可就丰富多了:

– 老年人占比27%(还是熟悉的配方)

– 年轻人占比27%(没想到吧!)

– 学生和职员各占10%

– 企业家和宝妈等群体也被盯上

封面新闻对1500名大学生的调查显示,超半数受访者本人或身边人遭遇过疑似AI诈骗,7成大学生坦言”防不胜防”。

学姐就想问,现在连大学生这种互联网原住民都招架不住,这AI诈骗是有多凶残?

地域分布也很有意思:

– 上海、北京、浙江等经济发达地区占比超45%

– 海外案例占5%

看来骗子也深谙”精准营销”之道,专挑有钱又爱尝鲜的地区下手。

这波,骗子们的”用户画像”做得比某些互联网大厂还专业!

三、AI诈骗的”技术流”操作

作为数码博主,学姐必须带大家看看这些骗子的”技术储备”:

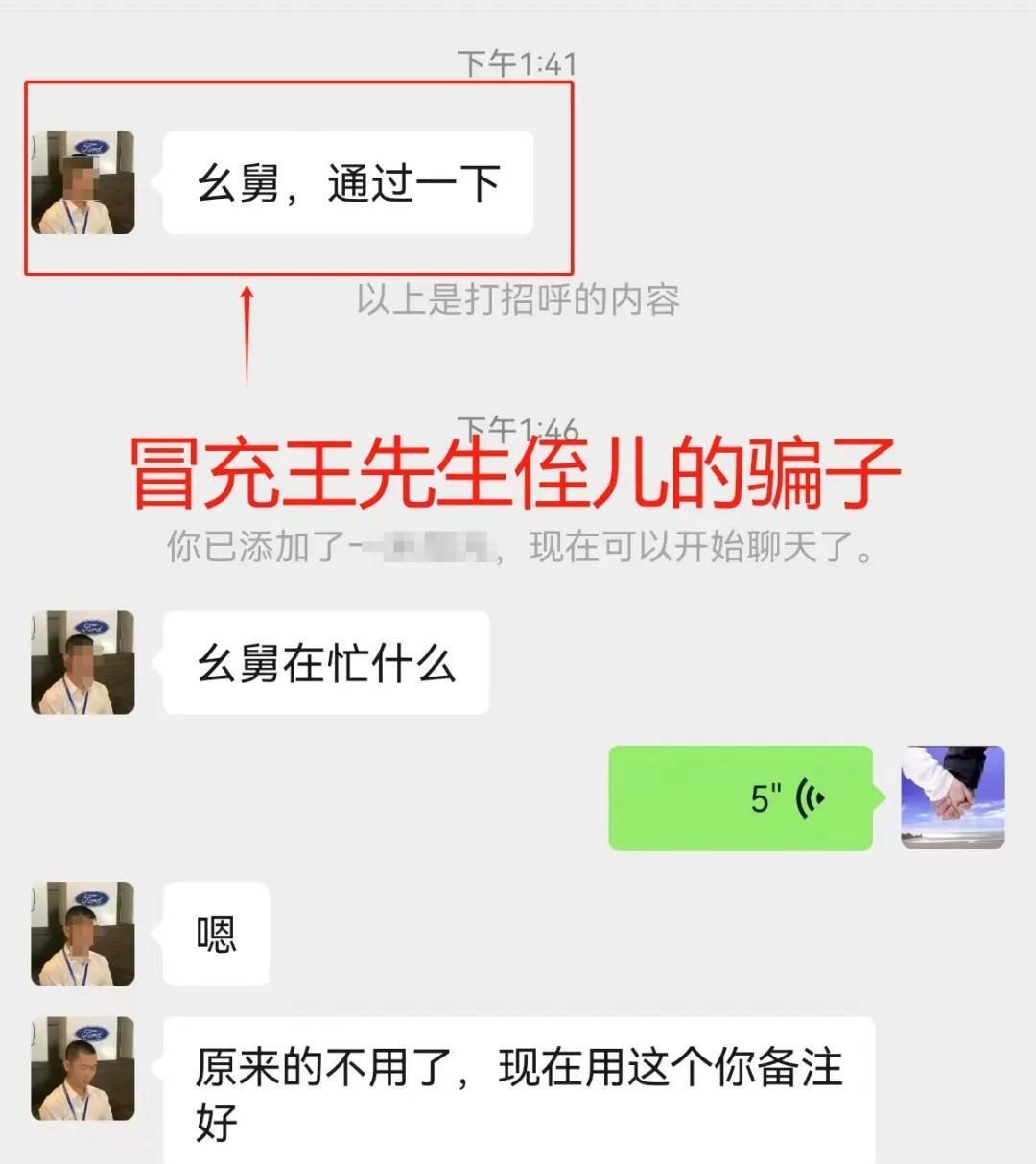

1. AI换脸:使用率近50%,连视频通话都能伪造

2. 语音合成:占比约40%,10秒就能克隆任何人声音

3. 深度伪造:从面部到全身3D合成,效果越来越逼真

4. 自动化脚本:批量维护诈骗账号,模拟人工聊天

四、防骗指南:数码老司机的生存法则

面对这种高科技骗局,学姐给大家支几招:

1. 视频防伪:遇到视频借钱,故意让对方做摸耳朵、转头等动作,AI换脸可能会有破绽

2. 声音验证:设置只有你们知道的暗语或问题

3. 转账必核实:无论多急,都要通过其他渠道二次确认

4. 信息保护:少在社交平台晒正脸视频、证件照片

5. 警惕异常:视频卡顿、声音断续、急要钱都是危险信号

公安部门提醒的”三不一多”原则要牢记:

– 未知链接不点击

– 陌生来电不轻信

– 个人信息不透漏

– 转账汇款多核实

五、行业与法律的”攻防战”

好在国家已经开始重拳出击:

– 2022年《互联网信息服务深度合成管理规定》实施,要求AI生成内容必须标识

– 2023年公安部专项打击,破获79起AI换脸诈骗案

– 福州用AI反制AI,通过智能外呼系统识别诈骗号码

但法律仍存在滞后性。

全国人大代表雷军就呼吁加强立法,学姐觉得这波雷总终于说了句大实话!

学姐总结

1. 提高警惕,眼见不一定为实

2. 加强个人信息保护

3. 支持行业监管和技术反制

最后灵魂拷问:如果你接到”学姐”的视频借钱,你会怎么验证真假? 欢迎评论区交流防骗心得!

(注:本文案例与数据均来自新京报、央视新闻等权威媒体报道)

津公网安备12011002023007号

津公网安备12011002023007号