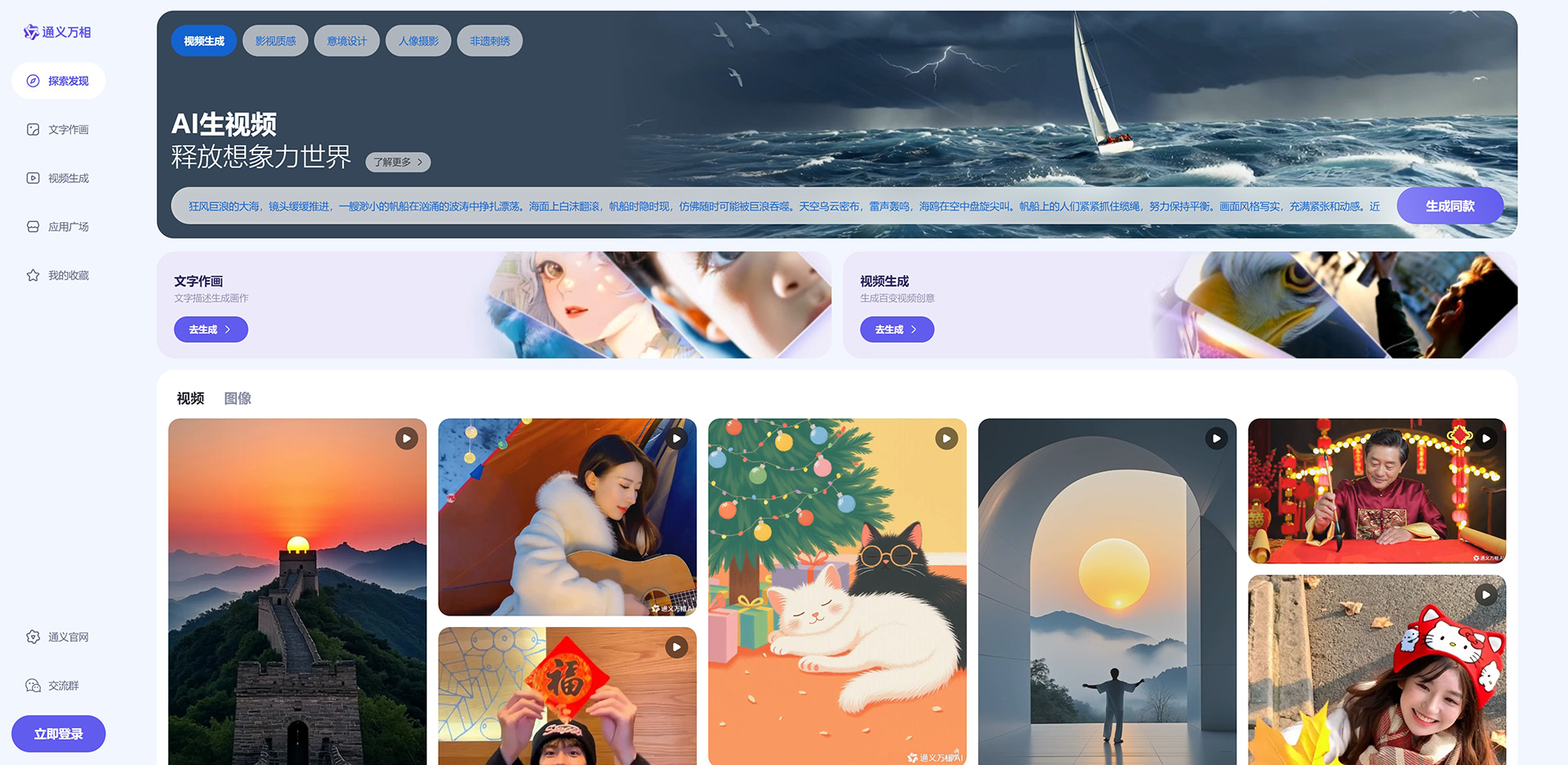

通义万相 – 阿里旗下AI视频与图像生成模型入口

通义万相是阿里旗下AI视频与图像生成模型。通义万相基于组合式生成模型 composer 研发,覆盖文本生成、图像理解、视频理解等全模态场景,可辅助人类进行图片、视频创作,应用于影视、广告、电商等多个领域。以下是具体介绍:

发展历程

- 2023 年 7 月 7 日,通义万相正式上线,并接入钉钉斜杠 “/”,用户可在钉钉文档、群聊等场景中唤起图片生成服务。

- 2024 年 9 月 19 日,在云栖大会上发布全新视频生成模型,具备插画设计、涂鸦作画、短片创作等场景化能力。

- 2025 年 1 月 9 日,升级推出万相 2.1 视频生成模型,在视频生成和图像生成能力上均有显著提升。

- 2025 年 2 月 25 日,阿里巴巴全面开源通义万相 2.1 模型,全球开发者可在 github 等社区下载体验。

- 2025 年 2 月 28 日,通义万相接入浙文互联的 AIGC 超级内容工厂好奇飞梭,同日接入荣耀智能体,用户可通过终端体验 AI 功能。

- 2025 年 7 月 28 日,通义万相 Wan2.2 模型正式开源,并全面接入通义 APP。

功能特点ad.yiban.io

- AI 图像生成:支持智能文生图,输入文字描述即可生成高质量艺术作品。还能基于现有图像进行风格转换和创意延展,提供写实、动漫、国风等数十种艺术风格,并且具备专业级的后期高清图像编辑工具。

- AI 视频生成:可通过文字描述生成具有电影质感的动态内容,也能将静态图像转化为生动的视频场景。支持从 480p 到 4K 多种分辨率选择,还能精准还原真实世界的物理规律,特别强化了中国传统文化元素的 AI 表现力。

最新模型 Wan2.2 的优势

- 采用 MoE 架构:是业界首个使用 MoE 架构的视频生成基础模型,由高噪专家模型和低噪专家模型组成。生成视频时,高噪专家模型先构建主体结构,低噪专家模型再生成细节,在同参数规模下,可节省约 50% 的计算资源消耗。

- 电影级美学控制系统:创新性提出「电影级美学控制系统」,将光影、色彩、镜头语言三大电影美学元素编码成 60 多个直观可控的参数。通过细粒度训练,能根据用户的美学提示词准确理解并响应用户的美学需求。

- 数据扩容:较上一代万相 2.1 模型,图像数据增加 65.6%,视频数据增加 83.2%。提升了模型的泛化能力与创作多样性,在复杂场景、美学表达和运动生成方面表现更加出色,画面生成更稳定,镜头表达更准确。

- 小尺寸模型可消费级显卡部署:Wan2.2 – TI2V – 5B 版本为统一视频生成模型,单一模型同时支持文生视频和图生视频,采用高压缩率 3D VAE 架构,仅需 22G 显存即可在数分钟内生成 5 秒高清视频,可在消费级显卡部署。

接入平台

- 钉钉:通义万相接入钉钉斜杠 “/”,用户可在钉钉文档、群聊、会议等场景中唤起做图、绘画等图片生成服务。

- 荣耀智能体:2025 年 2 月 28 日,通义万相接入荣耀智能体,用户可通过 Magic7 系列手机等终端体验 AI 功能。

- 通义 APP:2025 年 7 月 28 日,通义万相 Wan2.2 全面接入通义 APP,手机用户在 APP 中输入文本或图片,可生成具备电影级质感的 1080P 高清视频。

Copyright©2023-2026 AIGC工具导航 津ICP备2022006237号-2  津公网安备12011002023007号 互联网违法和不良信息举报渠道

津公网安备12011002023007号 互联网违法和不良信息举报渠道