公元2020年左右,也就是当下,对于经典科幻电影来说是一个科技发展的重要节点。

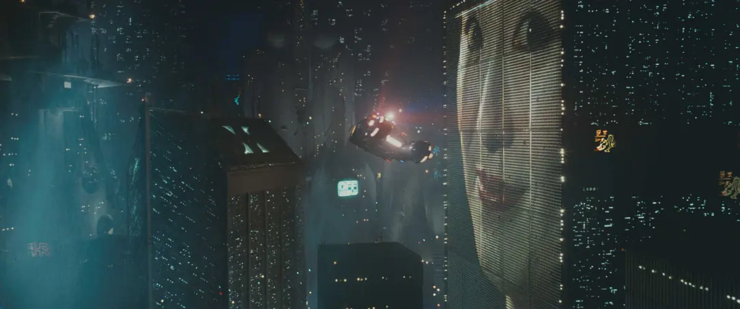

1982年上映的电影《银翼杀手》,对2019年的世界进行了华丽冰冷的幻想 —— 复制人、飞行汽车、电子器官、星球殖民……

想象力爆炸的80时代,让创造者充满了对未来科技的渴望与信任,他们认为40年时间已足够科技发展到幻想水准。

然而事实是,如今再品《银翼杀手》,看着男主角在刚过去不久的2019年开着飞行汽车追击复制人,实在让科幻迷们有些笑不出来——当初幻想的步子还是迈得太大了。我们的城市没有变成赛博朋克风格;机器人还没有做到复制人以假乱真的水准;汽车无人驾驶都还没研究成,更别提飞了……

图注:《银翼杀手》中2019年的赛博朋克城市

当人们感叹如今的科技发展完全跟不上80年代的想象时,最近却有一种技术野蛮生长,一经问世便引起圈层地震。虽还没有完全长成,但它很有可能取代世界上最有才华的一群人类——创作者。

这就是 AIGC( AI Generated Content)。

AIGC,即 AI 生成内容技术,让 AI 完成原本只有人类才能做到的原创性工作。这个科幻电影都没敢想象能在2022年成真的技术,却真的提前来到了我们身边,并以天为单位不断进化。

就在2个月前,「文生图(text-to-image)」还是外网网友和中国极客才能玩到的小众黑科技,而2个月后的现在,直接通过微信小程序或手机 APP 就能体验到 AI 绘画。就算是完全不会画画的人,输入一段文字,AI 便能生成一张像模像样的图片,要是文字调教得好,还能生成颇为惊艳的杰作。

这不由得让艺术界警铃大作:AI 都能带着不会画画的人飞,我学艺几十年图个啥!

就当文字爱好者以为文学置身事外时,早已有作者使用 AI 文本生成产品写小说。有人生成短篇小说发表到知名平台,有人制作长篇小说成功签约赚订阅费,共同点是都隐瞒了使用 AI 的真相。读者熬夜看玄幻小说看得心潮澎湃,压根不知道自己看的小说根本不是人类写的。

有人创意强但没创作能力,认为 AI 是帮助自己产出佳作的利器;有人热爱原创,认为 AI 生成内容是对「原创」二字的亵渎——无论事实更偏向何种情况,不可否认的是,AIGC 颠覆了内容创作的方式,且永远不可逆转。

AIGC 凭什么爆火?

AIGC 爆火的真相,恰恰蕴含在「人类被替代」的恐慌当中 —— 内容创作方式终于走下了神坛。

在上个世纪,只有专业人士能发表小说、拍电影;而近年,已有大量非专业人士成功发表了原创网络小说,在抖音等短视频平台上发布自制短视频甚至微电影 …… 生机愈见繁荣,但内容创作方式仅仅是从 PGC (专业生成)转向 UGC(用户生成),开放的门缝不宽,对于「才华」的要求也只高不低。

而 AIGC 在今年秋天的问世,激起学艺者慌乱之余,令世人看到一场内容创作方式的革命开端 —— 每个人都能做编剧、作家、漫画家、分镜师、动画导演……每个人都能成为任何一种内容创作者。

要知道,一切依靠互联网而繁荣的生态都需要流量,而流量只会为了内容而来。如果 AI 能将创作的大门开放给所有人,将创作权下放到每个人手中,AIGC 在这片蓝海中创造的价值将突破想象!

然而,AIGC 这个概念似乎随着井喷的「文生图」产品出现并一举成名。可找个业内人士打听,会发现这个名词其实早在数年前就出现在了产品经理口中,只是没什么人关注而已,但 AIGC 绝对不是一个新鲜玩意。

况且,让 AI 画图的工作早已出现不少,其中有开辟之功的莫过于 2014 年问世的对抗生成网络 GAN (Generative Adverserial Network)。

GAN 模型利用现成样本来生成新图像,最为人知的是其生成人脸的能力,喂入大量人脸数据,GAN 便可生成真假难辨的人脸图片。

GAN 模型的现世激发了大量研究人员的灵感,纷纷下场打造各种基于 GAN 的生成技术:能够合成高保真图片的 BigGAN,能够将卫星图像转化成谷歌地图的 pix2pix 技术、能将艺术画作和照片互相转化的 CycleGAN …… 除了图片生成技术,抖音、快手等短视频平台中层出不穷的「变老特效」、「假笑特效」、「让老照片动起来」等视频特效的背后,其实也都是 GAN 在发挥妙用。

GAN 模型的出现明明推动了 AI 绘画的一大步,却并没有卷起 AIGC 风潮。而当 AIGC 再出现,已经贵为 2022 年度最热词汇……这让人不由得疑惑:AIGC 到底做对了什么,才让自己成功翻红?

从未离商业化如此近

AIGC 概念的爆火,源于其前所未有的技术成熟度。而 AIGC 摆脱过去桎梏的图像生成,走向商业化的成熟路线,正是由于这几个机缘:

大模型

当「一句话 AI 绘图神器」走红,世人皆以为重点在「AI 绘图」上,可实际上,工作重点应在于如何理解用户输入的那一句话。

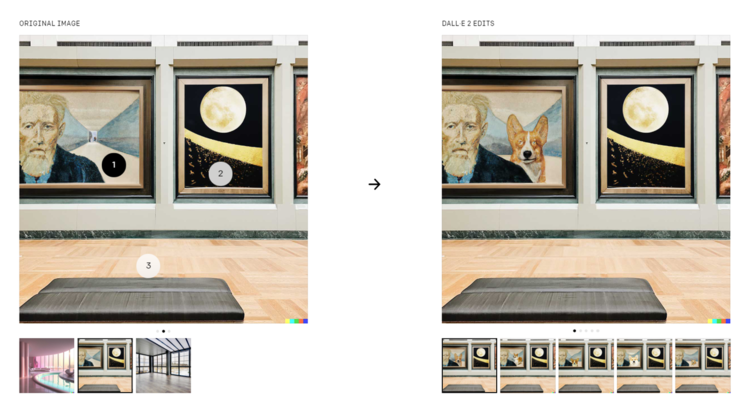

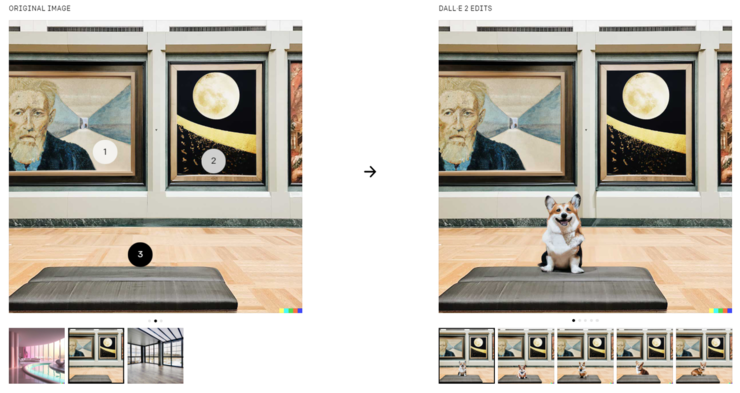

理解语言,恰恰是大模型玄学般的能力之一。当 DALL·E 2 初推出时,便出了这么一个惊艳的案例:

当用户要求在人物画上生成柯基时,DALL·E 2 会把柯基画入画中;

而当用户要求在座位上生成柯基的时候,它便生成了一只真实的、三次元的柯基。

这一操作惊呆了当时关注 DALL·E 2 的网友,这一选择性的动作,说明 DALL·E 2 确实理解了什么!

而这种非人之身理解人言的超强能力,要归功于 DALLE·2 所基于的 GPT-3 —— 由于喂入的数据多,语言大模型 GPT-3 已经开始理解一些人类的常识。无论是 3D 还是 2D 的图像,就算画面再精美,仍然处于像素级别的较低水平创作;而 GPT-3 表现出对人类语言这种高水平产物的理解,这是在模型中极其罕见的能力。

不断涌现的各类例子都证明:模型越大,理解能力越强。可是 GAN 本身的结构设计及其生成逻辑,恰恰阻碍了模型不断变大,这与 AIGC 的发展需求相悖;反观 Diffusion 模型,其已经具备了大模型的特征:由简单元素构成,通过不停重复造出一个超大网络,且可训练稳定。这正符合 AIGC 对于大模型的需求。

同时,在生成方面,AIGC 已不局限于仅仅生成人脸或任何特定的某种图像。通过组合概念、元素生成更复杂的场景,走向「一个工具生成所有」的通用方向,这才是图像生成的未来。

而 GAN 需要一个特定的数据集进行学习。如要求生成人脸,就需要喂入人脸图像数据集,拓展生成其他图像的能力就稍弱。这就使得 GAN 不能成为通用的生成工具,想做一个特定功能的特效,就要为之训练专用的 GAN,而不能实现泛化使用。

研究人员们发现了大模型才是 AIGC 的正道, GAN 却和大模型之路存在多个相悖之处,这导致 GAN 只预热了图像生成,却从未敲开 AIGC 的大门。

美国物理学家费曼说过,「凡我不能创造的,我就还没有理解」,AIGC 不仅仅是生成,更被定义为建立在认知和理解基础上的创作,这正需要大模型的语言理解能力。

大模型,是 AIGC 的来处,更是 AIGC 的未来发展之方向。

可控性

GAN 模型的问世刺激了一波图像生成,自然有人想到在 GAN 上做文章,使之能够完成「文生图」的幻想级任务。

然而,想通过文本这样的抽象语义去控制 GAN 的生成是个大难题,GAN 难以按照用户描述去可控地生成画面。圈内先行者尝试基于 GAN 做文生图的技术如 StackGAN、AttnGAN 等,都出现了描述文本细节缺失、分辨率低、难以理解高层次语义信息等问题,生成质量较低。

而让 AIGC 爆火的两大功臣:Diffusion + CLIP,却解决了这个问题。

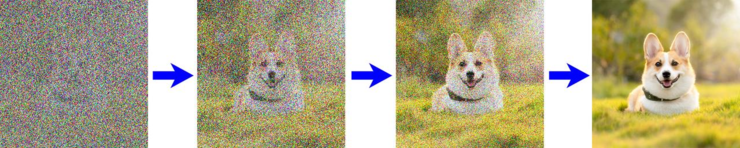

Diffusion 模型本身是为 DALL·E 2、Imagen等知名绘图神器所青睐的生成方式,不像 GAN 模型除了需要训练生成器,还需要额外训练判别器,Diffusion 模型只需要训练生成器,训练大大简化。同时,Diffusion 模型通过多步生成图片,且每一步都是一个自编码器,监督信息非常强,所以训练要稳定得多。

图注:Diffusion 模型生成过程

在如此强大的生成模型上,研究人员又为其嫁接上负责图文匹配验证的 CLIP 模型。当 Diffusion 生成图片后,交由 CLIP 验证图像特征值是否和输入文字匹配。如果特征值能通过匹配验证,就说明生成图像符合文字描述,也就是达成了「输入一段文字,输出符合要求的图片」的目标。

是 Diffusion + CLIP 让文字可控生成的梦想照进现实,做到了 GAN 未曾完成的事。

从此,人类终于可以通过文字与 AI 交流,征服 AI,让 AI 真正为人所用。

多模态

AIGC 爆火的机缘,还与语言大模型的兴起息息相关。

2020年左右,GPT-3 等语言大模型声名鹊起,为 AI 系统在处理跨模态中提供了海量优秀的文本-图像对的训练数据。正是这些高质量的训练数据为 AIGC 产品打好了基础,既帮助模型变大,又让模型不断学习并加深文本与图像匹配的认知。而这是在 GAN 初问世时不具备的外部条件。

通过文字画出绚烂图画,已然突破常人的想象,但仍有先行者思考,跨模态就是 AIGC 的尽头了吗?

想来不是。目前选择文本来生成图像,是因为文本现存数据最多,但世上存在如此多的模态,如果只用文本去做生成,那未免太局限了。

用手绘线条生成图像,用草稿加上文字生成图像,甚至是走向 3D模态 …… AIGC 的未来一定能兼容更多模态,而每一种不同的模态可以作为不同尺度的信息指导,便于灵活地生成更多有需求的任务。

AIGC 还需要攻破什么技术壁垒?

图片水平

有 AI 图像生成产品经理认为,国内的 AI 图像生成产品离真正走下去有不小差距,其中最本质的原因,当属生成细节不够好,达不到商业水平。

要知道图像生成翘楚 Midjourney 正是大量收集用户反馈的生成缺点,如手部奇怪、头发生成不佳等问题,按照用户反馈去调节训练数据,进行高频率优化,不断打磨生成效果,才得到了圈内几乎最佳的图片质量。

而 AIGC 产品一开始的定位,就决定了生成模型的结构设计和模型的优化方向:

国内的盗梦师平台出于别具匠心的产品设计,侧重于生成幻想风格的画面。如果选择生成真实风格图像,用户难免会带着挑刺的心理去比较生成图片跟真实世界的差距、但如果是玄幻、动漫等“二次元”风格,用户则会保持相对宽容的心态,倾向于欣赏图片美感。

图注:盗梦师生成作品

而 ZMO 公司从一开始就选择了真实图像的赛道,这是因为 ZMO 团队认为真实图像的生成才能真正影响一个具体的行业,如建筑绘图、电商图片、网页设计、商品外包装设计等等。如果 AIGC 产品的水平足够革新这些具体行业的内容生产方式,完全用 AI 代替人力完成这些工作,其产生的行业效益将不可估量。

提到图片生成水平, 还少不了提到一个叫做「组合性」的概念。

组合性首先是指生成模型掌握从生成单个物体、到生成整个场景,再到到生成整个世界的组合能力。

如今,生成一张人脸已很简单,但若要生成一个人在草地上玩耍,甚至是生成一个街区里有一群小孩在踢足球的画面,难度便大大上升。

组合性同时也指概念的组合能力。如果用户提出了现实世界没有的、数据集中没有的要求,比如牛油果椅子,骑在马上的宇航员等等,模型如何形成画面上的自洽,也是需要攻克的技术壁垒。

盗梦师创始人蓝振忠也说,「画得好看与画得言之有物之间是有差距的」。如今的 AI 图像生成产品能画出梦幻绚烂的图,但仅限于静态的表现,对于动词的理解力还较差。难以描述动态画面,更别提有连续性的情节,于是便出现了「唯美插图,言之无物」的问题。

如果 AIGC 能攻破这个技术壁垒,生成的不仅是一张单独的插图,而是能够画大场面、有动作、多人物、有故事情节的图,甚至能变成连环画中的其中一张、或漫画中的其中一页,那么 AI 图像生成就必然能走向更广的消费场景。

可控性

目前的 AIGC ,虽已跨出了文字控制的第一步,但可控性仍不尽如人意。

在图像生成方面,prompt (输入文本提示)的探索,已让用户们足够发愁。小白用户初次玩,输入一个简短的“太阳”,自以为已经很好理解,没想到生成出来的却是……

小白用户这才知道,prompt 没有那么容易上手,一张好图的背后,是资深创作者不厌其烦的多次尝试、加词、减字、生成……

因此,不乏有人提出,AI 公司得给肝时间和精力不断调试的创作者们分成,才能让有贡献的创作者们留存下来。但有 AI 图像生成产品的创始人指出,现在的 prompt 机制的确难以掌握,但这个技术问题在未来一定会被攻克,那时候资深创作者和小白用户的差距会被缩小,玩 AI 绘画的门槛会一降再降。

同时,生成平台在 prompt 输入上也有字数限制,这是因为目前模型处理长文本的能力还有限。要在输入上继续放宽条件,便要寄希望于大模型对人类语言理解能力的发展。

可解释性

1个月前,AI 科技评论在某文生图平台中输入「画一辆自行车并将其在地面上滚动的部分标黄」,得到的结果是:

而在现有的文生图平台中输入同样的文本提示,得到的结果如下:

比起1个月以前输入这个问题得到的结果,以上图片虽然没有正确标黄,但明显生成了有条理的画面,这足以体现 AIGC 公司们对自家模型的快速迭代。但无法正确标出「在地面上滚动的部分」,说明 AIGC 仍不理解自己笔下的世界,生成图片不符合三次元逻辑的问题,仍然急需改善。

AIGC 不是完全创造出一个不同的宇宙,AIGC 生成的结果,需要更贴合现实生活的物理规律与逻辑,换句话说,AIGC 应该在可解释性问题上做得更好,这应该是 AIGC 公司们共同为之奋斗的目标。

技术难题虽多,看似一片混沌,AIGC 技术却依然体现出了前所未有的清晰发展道路。因为 AIGC 从未如此目标明确,技术问题清晰——所谓的技术壁垒,其实更应该称之为工程问题,而解决工程,不过只是时间问题。

津公网安备12011002023007号

津公网安备12011002023007号