Token确定官方名称“词元”,一文全面解析什么是词元?

在人工智能产业快速普及的当下,“Token”一直是行业高频术语,却长期存在译名混乱、认知不一的问题——有人称其为“令牌”,有人叫“标记”,还有人误将其与区块链通证混淆。2026年3月24日,国家数据局正式官宣:AI领域核心术语Token的标准中文名称定为“词元”,人民日报、央广网等权威媒体同步解读,彻底终结了行业术语乱象。

词元不仅是一个简单的中文译名,更是AI大模型运行的核心基础单元,关乎算力消耗、计费标准、数据交互等关键环节。下面我们就从权威定义、本质特征、场景应用、行业价值等维度,全面拆解“词元”到底是什么。

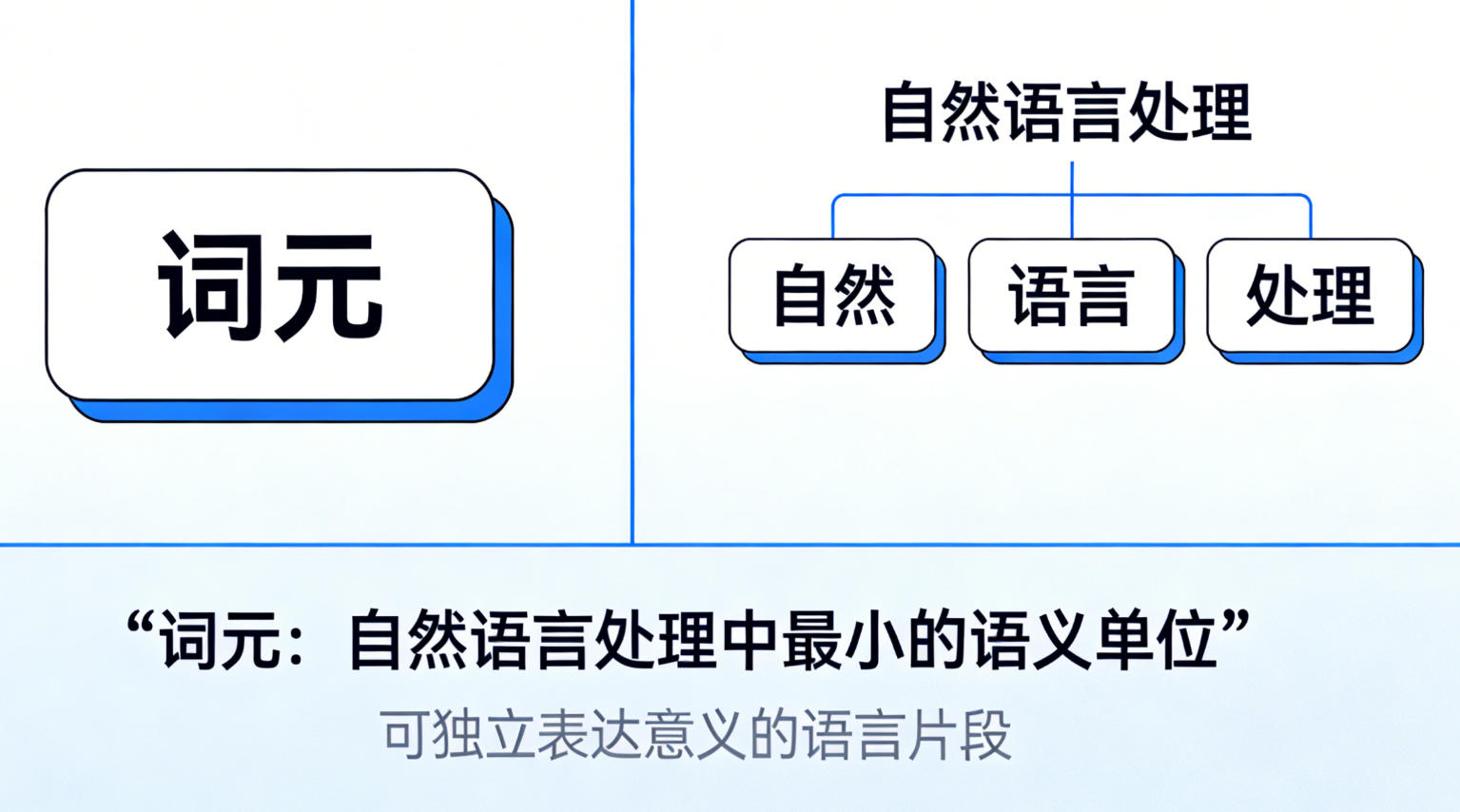

一、词元的官方权威定义:AI世界的最小信息单元

通俗来讲,人类阅读、书写文字以“字、词”为基本单位,而AI大模型理解、处理信息,必须先把所有内容拆解成“词元”再进行运算。无论是用户输入的提问、AI生成的文案/代码,还是图片、语音的底层编码,最终都会转化为词元进行解析,词元就是搭建AI交互的“最小积木”。

这里需要重点区分:AI领域的词元(Token),和区块链领域的“通证(Token)”完全是两个概念,二者应用场景、技术本质截然不同,官方定名后也彻底厘清了这一混淆。

二、词元的核心本质:不是单纯字符,而是语义颗粒

很多人误以为词元就是单个汉字、英文单词或标点符号,这是最常见的认知误区。词元的拆分逻辑是语义优先,而非单纯的字符分割,拆分规则灵活多变,核心特征如下:

- 颗粒度不固定:一个词元可能是半个汉字、一个单字、一个词组、一个标点,甚至是一个词根、数字符号。比如中文里“人工智能”可能拆分为1个词元,也可能拆分为“人工”“智能”2个词元;英文里“unhappiness”常拆分为“un”“happiness”2个词元。

- 中英文差异明显:中文语义凝练,单个词元承载的信息更多,通常1个汉字≈0.5-1个词元;英文单词拆分更细碎,1个英文单词≈1-3个词元,这也是中文AI交互更省算力、成本更低的核心原因。

- 跨模态通用性:词元不仅适用于文本处理,图像、语音、视频等多模态内容,也会被转化为词元进行编码处理,是AI全域交互的通用单元。

举个直观例子:用户输入“我爱中国”,大模型可能将其拆分为“我”“爱”“中国”3个词元,而非4个单字符;输入“AI大模型”,则可能拆分为“AI”“大模型”2个词元。

三、词元vs字符/单词:核心差异一目了然

为了让大家更清晰区分,我们通过表格对比词元与传统字符、单词的核心差别:

对比维度 | 词元(Token) | 普通字符/单词 |

|---|---|---|

拆分逻辑 | 语义优先,贴合AI理解逻辑 | 形态优先,按视觉符号分割 |

颗粒度 | 灵活可变,无固定长度 | 固定单一,一字/一词为单位 |

核心作用 | AI运算、算力计量、计费标准 | 人类阅读、书写、排版 |

适用场景 | 人工智能大模型交互 | 日常文字使用、传统文本处理 |

四、词元的核心应用场景:贯穿AI全产业链

词元作为AI运行的基础单元,应用场景覆盖AI交互、产业计费、数据统计等全链条,是智能时代的“通用货币”:

1. 大模型交互核心载体

用户与AI的每一次对话、提问、生成指令,AI输出的回答、文案、代码、图表,都要通过词元完成传输和运算。词元的数量直接决定AI的处理难度和响应速度,词元越少,AI运算越快、成本越低。

2. 算力消耗与计费标准

目前主流AI大模型均以词元为计费单位,按“输入词元+输出词元”总量收费,词元调用量也是衡量算力消耗的核心指标。据官方数据,我国日均词元调用量已突破140万亿,足见AI产业的活跃度。

3. 数据价值与产业统计

词元具备可计量、可交易的属性,成为AI数据要素流通的核心计量单位,助力企业测算AI投入产出、评估模型效能,也为行业监管、数据治理提供了统一标准。

4. 多模态AI处理

除了文本,AI生成图片、剪辑视频、转写语音时,也会将多媒体内容转化为词元进行编码解析,实现文本、图像、音频的全域交互。

五、词元定名的行业价值:规范产业,降低认知门槛

此次官方将Token定名为“词元”,绝非简单的翻译选择,而是对AI产业发展的重要赋能:

- 统一行业术语:终结了此前“令牌”“标记”等混乱译名,避免跨领域、跨企业的沟通障碍,让AI技术交流更规范。

- 降低大众认知门槛:“词元”二字通俗易懂,既贴合“语义单元”的本质,又便于普通用户理解AI交互逻辑,推动AI技术全民普及。

- 规范产业标准:为AI算力计费、数据统计、服务定价提供了权威依据,助力AI产业有序发展,防范定价混乱、数据统计不统一等问题。

- 厘清概念边界:明确区分AI词元与区块链通证,消除大众认知混淆,规避虚假宣传、概念误导等行业乱象。

六、实用小贴士:如何降低词元消耗?

对于普通用户和企业而言,掌握词元拆分逻辑,能有效降低AI使用成本:

- 提问尽量简洁凝练,避免冗余文字,减少输入词元数量;

- 优先使用中文交互,同等信息量下中文词元消耗量远低于英文;

- 明确指令需求,避免让AI生成无关内容,减少输出词元浪费。

总结

词元(Token)是AI大模型处理信息的最小语义单元,是智能时代算力计量、数据交互、产业计费的核心标准。官方定名“词元”,既厘清了技术概念,又规范了产业秩序,更是AI产业走向成熟、标准化的重要标志。无论是普通用户使用AI工具,还是企业布局AI产业,理解词元的本质,都是读懂人工智能的核心第一步。

津公网安备12011002023007号

津公网安备12011002023007号